Meestal gaan we op dit blog in veel stukken diep op de wetenschap in, wat voor nieuwkomers in het klimaatonderzoek lastig te volgen kan zijn. Dit keer probeer ik de basis te bespreken van de achtergrond van de bovenstaande zin. Het is een stuk tekst uit de samenvatting voor beleidsmakers van het IPCC AR5-rapport van 2013: de mens is de belangrijkste veroorzaker van de opwarming van de aarde sinds 1950. Niet iedereen gelooft deze uitspraak, maar de klimaatwetenschap is er toch erg zeker van.

Nadat Galileo, Fahrenheit en Celsius zich in het verre verleden met het meten van de temperatuur en de thermometer hadden bemoeid, hebben mensen ook de temperatuur van hun omgeving gemeten en vastgelegd. In Nederland startte dat bijvoorbeeld al aan het einde van de 17e eeuw. Naarmate de tijd vorderde, werden deze meetmethoden uiteraard steeds beter en werd er op steeds meer plaatsen in de wereld gemeten. Deze temperatuurmetingen vormen de basis van de bepaling van de mondiale temperatuurverandering van de afgelopen paar honderd jaar door een aantal onderzoeksgroepen. De bekendste groepen die zich daar mee bezighouden zijn NASA GISS en NOAA-NCDC uit de VS, het Engelse Met Office Hadley Centre/CRU of het Japan Meteorological Agency, je komt hun gegevens vaak tegen onder de namen GISTEMP, NCDC, HadCRUT en JMA. De Amerikaanse groepen rapporteren mondiale temperatuurdata die starten in 1880, de Japanse data starten in 1891 en de data van de Engelse groep starten zelfs in 1850.

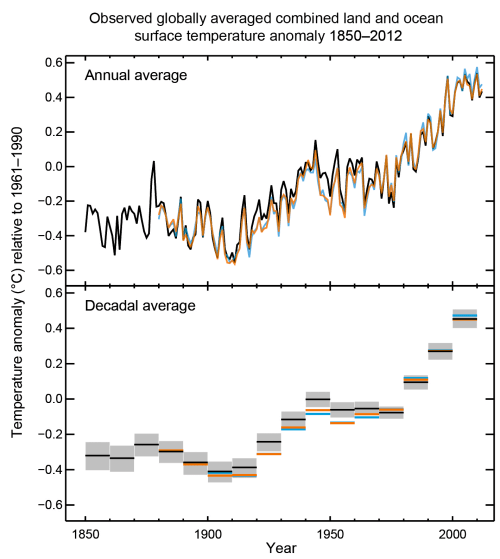

De grafiek in onderstaande figuur komt uit het IPCC AR5-rapport en geeft de temperatuurontwikkeling op aarde weer vanaf 1850, gebruik makend van de resultaten van de drie hierboven genoemde onderzoeksgroepen. In de grafiek is de gemiddelde temperatuur op aarde over de periode 1961 – 1990 op 0 gesteld en dus geven alle lijnen in de grafiek de afwijking van de temperatuur weer t.o.v. die referentie periode (de temperatuur anomalie). Eén ding valt direct op als je naar de grafiek kijkt: het is warmer geworden op aarde sinds het einde van de 19e eeuw en dan vooral na 1970. Na 1970 is ook elk decennium warmer geweest dan het voorgaande. Volgens het IPCC is het op aarde sinds 1880 circa 0,85 °C warmer geworden en na 1950 circa 0,65 °C.